Le mura del castello sono digitali. E qualcuno ha già trovato la porta sul retro

Nel Medioevo, assediare un castello significava tagliare i rifornimenti, logorare le difese, aspettare. L’obiettivo non era necessariamente abbattere le mura, ma rendere insostenibile la vita dentro. Chi controllava l’accesso controllava il territorio. Oggi quella logica si applica alle infrastrutture digitali. Chi controlla i componenti di una rete, i fornitori di un sistema critico, gli strumenti con cui si rilevano le vulnerabilità, controlla qualcosa di molto simile a un castello. E l’assedio, quando arriva, non si vede.

È in questo scenario che va letta la proposta di riforma del Cybersecurity Act pubblicata dalla Commissione europea il 20 gennaio 2026. Non è ancora legge: il negoziato tra Parlamento europeo e Consiglio è atteso nel corso del 2026, e solo una volta adottato il regolamento si applicherà direttamente in tutti gli Stati membri. Il punto più delicato riguarda i fornitori: le nuove norme imporrebbero agli Stati membri di escludere i cosiddetti fornitori ad alto rischio da 18 settori critici, tra cui energia, trasporti e sanità, renderebbero vincolanti le linee guida del 5G Toolbox (un insieme di misure comuni approvate dalla Commissione Europea per mitigare i rischi di sicurezza informatica legati alla diffusione delle reti 5G) ed estenderebbero le restrizioni oltre le reti mobili, fino alla fibra ottica, ai sistemi per l’energia solare e agli scanner di sicurezza. Per gli operatori di reti mobili già attivi è previsto un periodo di phase-out di 36 mesi dall’entrata in vigore. Il testo non fa nomi, ma il bersaglio è riconoscibile.

Il quadro normativo e la reazione internazionale

La proposta si inserisce in un quadro normativo che si va densificando. In parallelo, la Commissione ha proposto modifiche mirate alla direttiva NIS2, che fissa gli obblighi di cybersicurezza per gli operatori di servizi essenziali in tutta Europa, con l’obiettivo di semplificare la conformità per circa 28.700 aziende, incluse migliaia di micro e piccole imprese. Si aggiunge la direttiva CER (Critical Entities Resilience), che estende una logica analoga alle infrastrutture fisiche critiche, coordinando la resilienza digitale con quella materiale di reti energetiche, trasporti e acqua. Il Cyber Resilience Act è già in vigore, con scadenze operative fissate a settembre 2026 per il reporting e a dicembre 2027 per l’applicazione completa dei requisiti sui prodotti digitali. In questo disegno complessivo cresce anche il ruolo di ENISA, l’Agenzia europea per la cybersicurezza, che il pacchetto normativo rafforza come punto di riferimento per la certificazione e la supervisione a livello continentale.

Tensioni geopolitiche e dipendenze tecnologiche

La risposta di Pechino è arrivata puntuale. Il Ministero del Commercio cinese ha dichiarato che se le aziende cinesi dovessero subire trattamenti discriminatori, la Cina potrà adottare misure per tutelare i propri interessi commerciali, pur ribadendo che dialogo e cooperazione restano la strada preferita. Una pressione formulata nei toni della diplomazia, che non lascia molto spazio all’ambiguità. Pechino sostiene che il testo viola i principi dell’Organizzazione Mondiale del Commercio, invade le competenze nazionali degli Stati membri e danneggerà le relazioni economiche tra Cina e Unione europea. Alcuni dei principali vendor interessati hanno denunciato formalmente il rischio di una discriminazione geografica sistematica, chiedendo che la valutazione del rischio rimanga ancorata a criteri tecnici verificabili.

Non è solo la Cina a sollevare obiezioni. Anche alcuni operatori europei contestano il meccanismo proposto: escludere fornitori sulla base di valutazioni geopolitiche piuttosto che di sicurezza tecnica misurabile introduce un’arbitrarietà che ha costi reali, in termini economici e di tempi di sostituzione, distribuiti in modo non uniforme tra settori e paesi. È una critica che merita attenzione, anche se non dissolve la questione di fondo. Quella questione è strutturale. Più dell’80% delle tecnologie e delle infrastrutture digitali europee è importato, e oltre il 70% dei modelli di intelligenza artificiale fondazionali a livello globale proviene dagli Stati Uniti. I grandi operatori americani controllano più del 70% dell’infrastruttura cloud europea. La dipendenza da fornitori di hardware per le reti di telecomunicazione e da operatori americani per quasi tutto il resto non è una scelta strategica consapevole. È una condizione consolidata nel tempo, che oggi l’Europa cerca di rinegoziare in un momento in cui i rapporti di forza sono già definiti.

La corsa contro il tempo e la guerra ibrida

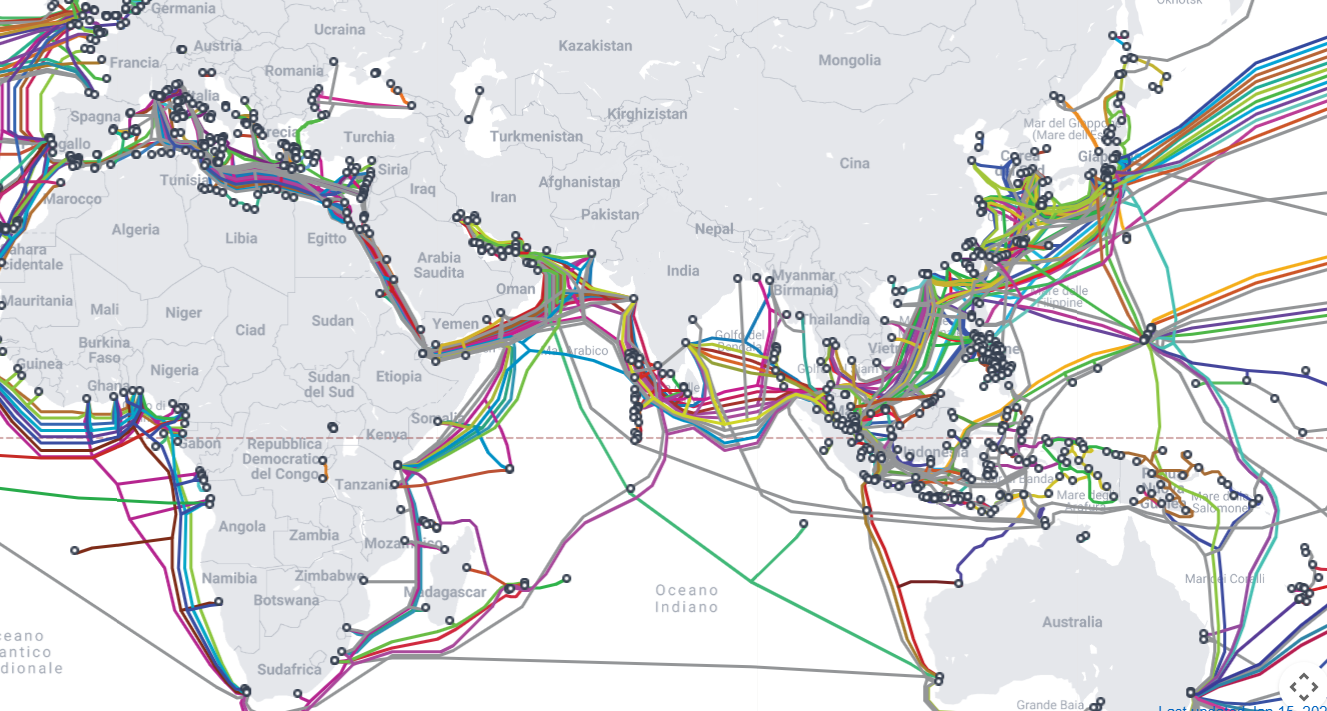

Il problema è che mentre le istituzioni lavorano al quadro normativo, la tecnologia si muove ad alta velocità. Il conflitto cyber è oggi continuo e strutturale. Gli Stati che perseguono strategie di guerra ibrida puntano a posizionarsi in anticipo nelle infrastrutture critiche, sfruttando gruppi criminali come proxy. Gli obiettivi strategici includono internet e cloud, satelliti, cavi sottomarini. Non si tratta di scenari futuri: è la condizione operativa attuale di chi gestisce infrastrutture critiche in Europa, dalle reti energetiche ai sistemi di trasporto, dalle telecomunicazioni ai porti.

Le stesse tecnologie che servono a difendere possono essere usate per attaccare, e la linea che separa le due funzioni dipende interamente da chi le usa e con quale scopo. Il caso Mythos, già raccontato su queste pagine, lo ha reso evidente: annunciato il 7 aprile con accesso riservato a un consorzio di aziende selezionate, il modello è stato raggiunto il 21 aprile da un gruppo non autorizzato, attraverso le credenziali di un fornitore terzo. Due settimane, non ore. Il che non cambia la sostanza del problema, ma dice qualcosa sulla fragilità dei perimetri anche quando l’intenzione di presidiarli è esplicita.

La revisione del Cybersecurity Act non va letta isolatamente, ma come parte di un disegno più ampio che comprende NIS2, CER, il Cyber Resilience Act e il regolamento DORA per il settore finanziario. Il segnale è quello di un’Unione che cerca di costruire un impianto coerente di governance della sicurezza digitale, riducendo le sovrapposizioni e spingendo verso una lettura integrata del rischio. È un’ambizione razionale, ma sullo sfondo si intravede qualcosa di più strutturale: la progressiva costruzione di blocchi tecnologici separati, dove standard, tecnologie e fornitori non sono più interoperabili ma politicamente connotati. La domanda aperta è se i tempi istituzionali europei siano compatibili con la velocità a cui quella frattura si allarga.

Il castello medievale cadeva quando chi stava dentro esauriva le riserve, non quando le mura cedevano. L’Europa ha ancora le riserve. La questione è quanto stia impiegando a capire che l’assedio è già cominciato.